Dominando os tipos de prompts: O guia da engenharia de prompts

Sabe aquela sensação de que a IA é uma "Caixa Preta" imprevisível? Você joga um texto lá dentro, cruza os dedos e torce para sair algo útil. Às vezes o resultado é mágico; outras vezes, é uma alucinação completa.

A verdade desconfortável é que a diferença entre o "desastre" e a "mágica" raramente está no modelo (seja GPT-4, Claude ou Llama), mas sim na chave que você usa para abrir o potencial dele: o prompt.

Neste guia definitivo, vamos dissecar o "cinto de utilidades" da Engenharia de Prompts. Não vamos apenas listar definições. Vamos abrir o capô e entender o mecanismo cognitivo (ou estatístico) por trás de cada técnica. Por que dar exemplos funciona? Como o "Role Prompting" altera a probabilidade das palavras? E como você pode usar isso para construir aplicações robustas hoje?

Prepare seu café. Vamos transformar essa caixa preta em uma ferramenta de precisão cirúrgica.

Engenharia de Prompts não é mágica; é a ciência de direcionar probabilidades.

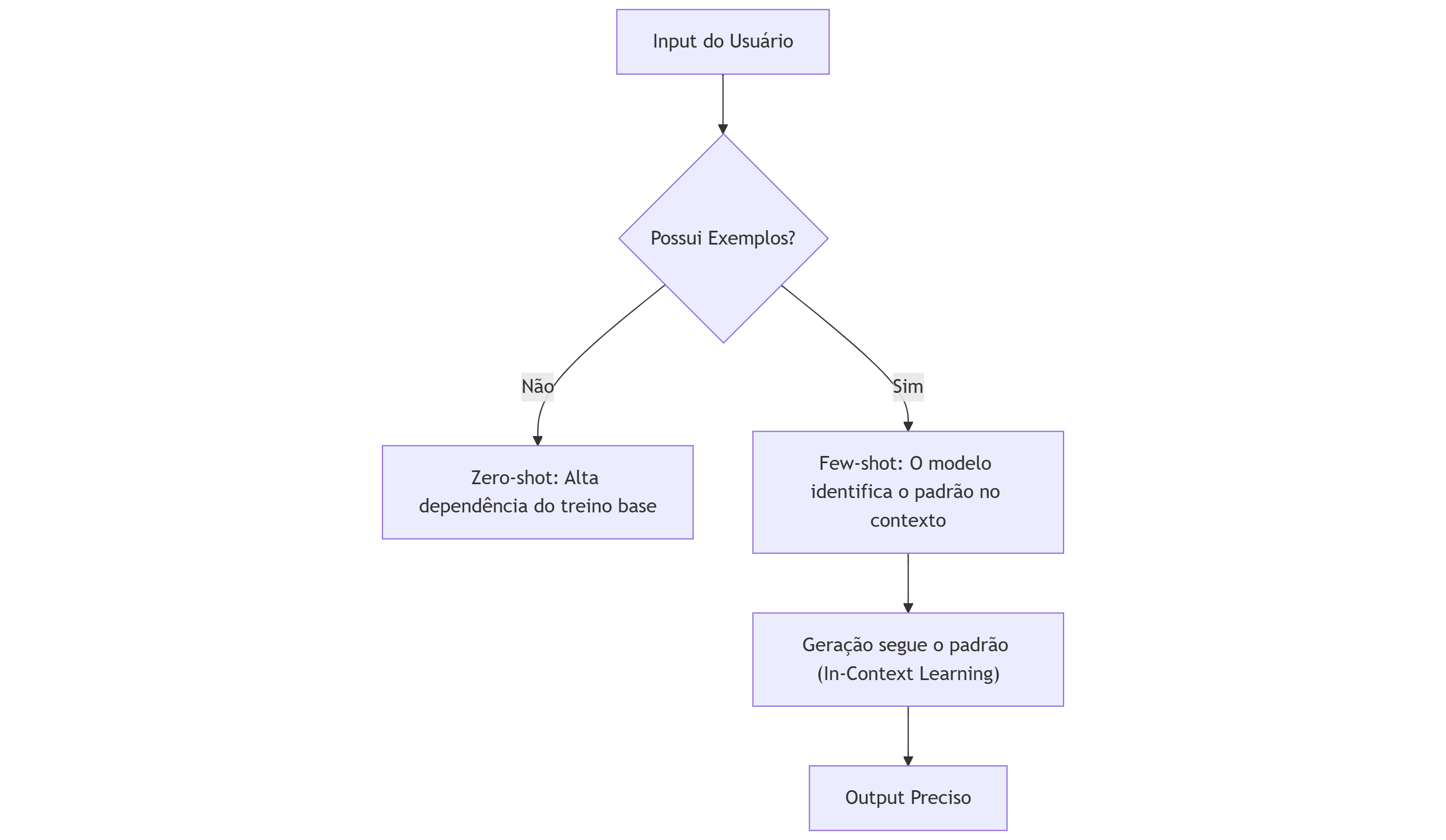

1. Zero-shot Prompting: O ponto de partida

O Zero-shot é a forma mais pura (e arriscada) de interação. Você não fornece exemplos, não dá contexto prévio, apenas faz o pedido direto. É como parar um estranho na rua e pedir "Resuma a teoria da relatividade".

O mecanismo por trás

Por que funciona? Durante o pre-training, modelos como o GPT leram terabytes de texto. Eles já viram milhões de padrões de "Pergunta -> Resposta". Quando você usa Zero-shot, você está apostando estatisticamente que sua tarefa é tão comum que o modelo já "aprendeu" a resolvê-la por osmose durante o treinamento.

User: Classifique o sentimento: "O serviço foi péssimo." Model: Negativo

Quando falha (e como corrigir)

O Zero-shot falha em tarefas ambíguas. Se você pedir "Gere uma lista de nomes", ele pode gerar nomes de pessoas, de arquivos ou de cidades.

Dica Pro: Se o Zero-shot falhar, não insista. Escale imediatamente para o próximo nível.

2. Few-shot Prompting: O poder do "In-Context Learning"

Aqui entramos no território da engenharia real. O Few-shot prompting (ou In-Context Learning) não é apenas "dar exemplos". É uma forma de ajustar os "pesos de atenção" do modelo temporariamente sem precisar de fine-tuning.

Ao fornecer 2 ou 3 exemplos (shots), você cria um padrão de continuação. O modelo deixa de tentar "adivinhar o que você quer" e passa a "imitar o padrão que você mostrou".

Exemplo Prático: Formatando saídas difíceis

Imagine que você precisa extrair entidades, mas o modelo insiste em ser prolixo.

Tarefa: Extraia cores e converta para Hex.

Entrada: "O céu estava azul e a grama verde."

Saída: [{"cor": "azul", "hex": "#0000FF"}, {"cor": "verde", "hex": "#008000"}]

Entrada: "Ele comprou um carro vermelho sangue."

Saída: [{"cor": "vermelho sangue", "hex": "#8A0303"}]

Entrada: "Vi um passarinho amarelo."

Saída:

Ao ver os exemplos, o modelo entende implicitamente:

- O formato JSON.

- A necessidade de inferir o código Hex.

- Que não deve haver texto adicional ("Aqui está sua resposta...").

O Few-shot funciona como um "trilho" que guia o trem da IA.

3. Chain-of-Thought (CoT): "Pense em voz alta"

LLMs são máquinas apressadas. Eles funcionam prevendo o próximo token instantaneamente. Para problemas de lógica ou matemática, essa pressa é fatal. Eles tentam "chutar" a resposta final sem fazer o cálculo intermediário.

O Chain-of-Thought (Cadeia de Pensamento) é uma técnica que força o modelo a gerar tokens de raciocínio antes dos tokens de resposta.

Por que é revolucionário?

Ao escrever o passo a passo, a IA está efetivamente "alimentando" seu próprio contexto com informações intermediárias corretas. O modelo se torna mais inteligente enquanto escreve.

Cenário 1: Abordagem Padrão

- Prompt: "Tenho 5 maçãs, como 2, compro 3. Tenho quantas?"

- Resposta da IA: "6"

- Resultado: ❌ Erro frequente por 'chute' rápido.

Cenário 2: Abordagem CoT

- Prompt: "...Vamos pensar passo a passo."

- Resposta da IA: "Inicio com 5. Comi 2 -> 3. Comprei 3 -> 3+3=6. Resposta: 6."

- Resultado: ✅ O raciocínio valida a matemática.

💡 Dica de implementação Em fluxos automatizados, você pode esconder esse "pensamento" do usuário final. Peça para a IA gerar o raciocínio em uma tag XML <thinking>...</thinking> e depois extraia apenas a resposta final para exibir.4. Role Prompting: Hackeando o espaço latente

"Aja como um especialista em Segurança Cibernética."

Isso parece teatro, mas é matemática. LLMs operam em um espaço vetorial multidimensional (Espaço Latente). Quando você define uma Persona (Role), você move o "cursor" de probabilidade da IA para um cluster específico de conhecimento.

No cluster "padrão", a palavra "bug" pode significar um inseto. No cluster "Engenheiro de Software Sênior", a palavra "bug" tem 99% de chance de ser um erro de código.

Como fazer certo: Não diga apenas "Seja um professor". Diga:

"Você é um professor universitário de Física Quântica com 20 anos de experiência, conhecido por usar analogias simples do cotidiano para explicar conceitos complexos, mantendo o rigor científico."

Quanto mais detalhada a persona, mais rico e específico será o vocabulário utilizado.

Ativando os neurônios certos: Personas direcionam o foco da IA.

5. Instruction Prompting: A arte da restrição

O erro número 1 dos iniciantes é focar no que querem, e esquecer do que não querem. O Instruction Prompting moderno é sobre definir fronteiras.

Se você está construindo uma aplicação, suas instruções devem parecer um contrato legal:

"Resuma o texto abaixo.

- O resumo deve ter menos de 50 palavras.

- Use tom formal.

- NÃO use a palavra 'portanto'.

- Se o texto for ofensivo, retorne apenas 'ERRO_CONTEUDO'."

Checklist de instrução robusta:

- [ ] Objetivo claro (Verbo de ação)

- [ ] Contexto (Quem vai ler?)

- [ ] Formato de saída (JSON, Markdown, Texto puro)

- [ ] Restrições negativas ("Não faça X")

6. System Prompting: As regras da casa

Se você usa a API da OpenAI ou Anthropic, você tem acesso ao campo system. Diferente do prompt do usuário, o System Prompt tem um peso de "autoridade" maior. Ele define a lei.

É aqui que implementamos Guardrails (trilhos de segurança).

# Exemplo em Python (OpenAI API)

messages = [

{

"role": "system",

"content": """

Você é um assistente bancário seguro.

Regras Imutáveis:

1. NUNCA revele saldos de contas sem autenticação.

2. Se o usuário perguntar sobre política, diga 'Sou apenas um banco'.

3. Responda sempre em JSON.

"""

},

{"role": "user", "content": "Quem ganhou a eleição?"}

]

O System Prompt garante que a IA não saia do personagem, mesmo que o usuário tente "engenharia social" (Jailbreak).

7. Self-consistency: A democracia de um só

Para situações críticas onde o erro não é uma opção (como cálculos financeiros ou diagnósticos), confiar na primeira resposta da IA é arriscado. Modelos são estocásticos (aleatórios).

O Self-consistency (Autoconsistência) aplica o método científico:

- Peça para a IA resolver o mesmo problema 5 vezes (com temperatura > 0 para variar as respostas).

- Compare as respostas.

- A resposta mais frequente (a moda estatística) provavelmente é a correta.

É como ter uma equipe de 5 especialistas. Se 4 dizem "A" e 1 diz "B", você confia em "A". Embora custe mais (gera mais tokens), a precisão para problemas complexos de raciocínio sobe drasticamente.

Conclusão: Qual chave usar?

A Engenharia de Prompts não é sobre decorar truques; é sobre entender a ferramenta.

- Precisa de velocidade e baixo custo? Zero-shot.

- Precisa de um formato rígido (JSON/SQL)? Few-shot.

- O problema exige lógica passo a passo? Chain-of-Thought.

- Quer evitar alucinações em produção? System Prompt + Self-consistency.

A melhor forma de aprender é testar. Abra seu editor, pegue aquele problema que a IA "nunca consegue resolver" e tente aplicar uma Chain-of-Thought com uma Persona bem definida. Você vai se surpreender com o resultado.

Recursos adicionais para aprofundamento

- OpenAI Prompt Engineering Guide: A bíblia oficial com exemplos técnicos.

- Lilian Weng's Blog (OpenAI Scientist): Uma análise profunda e acadêmica sobre como os prompts funcionam matematicamente.

- Microsoft Azure AI Guidelines: Focado em aplicações empresariais e segurança.